[우리문화신문=정운복 칼럼니스트]

언제부턴가 인공지능이 우리 생활에 깊숙이 스며들고 있습니다.

심지어 네이버나 다음처럼 포털사이트의 검색 기능까지 대체하고 있지요.

그런데 인공지능 알고리즘은 결코 중립적이지 않습니다.

인공지능은 편향된 데이터를 제공하는 경우가 많습니다.

왜냐하면 주어진 데이터만을 기반으로 학습하기 때문이지요.

만약 특정 성별, 인종, 사회경제적 계층의 데이터가 부족하거나 편향된 데이터만 존재한다면, 알고리즘은 그러한 편견을 학습하여 차별적인 결과를 내놓을 수 있습니다.

또한 과거의 데이터에는 사회적 불평등, 차별 등의 역사적 편견이 반영되어 있을 수 있습니다. 이러한 편견이 학습된 알고리즘은 현실 사회의 불평등을 심화시킬 수 있습니다. 그리고 알고리즘을 설계하는 개발자의 의도, 가치관, 그리고 무의식적인 편견이 알고리즘에 반영될 수 있습니다. 예를 들어, 특정 집단에 대한 선호나 편견이 알고리즘에 스며들어 불공정한 결과를 초래할 수 있지요.

인공지능은 사용자의 되먹임(피드백)을 통해 학습하는 강화 학습을 통해 더욱 정교해집니다.

사용자의 되먹임 자체가 사회적 편견을 반영하고 있을 수 있으며,

이는 알고리즘의 편향성을 심화시킬 수 있습니다.

어느 날 갑자기 신문을 보다가 특정한 뉴스에 관심이 생겨 유튜브 채널을 보았습니다.

문제는 그 채널이 강한 보수적 색채를 띠고 있었다는 것이지요. 그런데 유튜브에 들어가면 내가 원하지 않았던 보수와 관련된 채널들이 다수 올라와 있습니다. 그것을 몇 번 보게 되면 나중엔 보수 채널로 도배된 유튜브를 만날 수밖에 없습니다.

이것은 편향된 사고방식을 초래할 수 있습니다.

문제는 자신도 모르는 사이에 그것이 심화하고 강화된다는 사실이지요.

결론적으로 알고리즘에 조종되는 현상을 겪을 수 있다는 이야기가 됩니다.

인류에게 많은 혜택을 가져다주는 강력한 도구로서 인공지능은

편향성 문제를 해결하지 않고는 그 잠재력을 충분히 발휘하기 어렵습니다.

그러니 항상 문제점을 인식하고 깨어있을 필요가 있습니다.

인공지능(AI)에게 물었습니다.

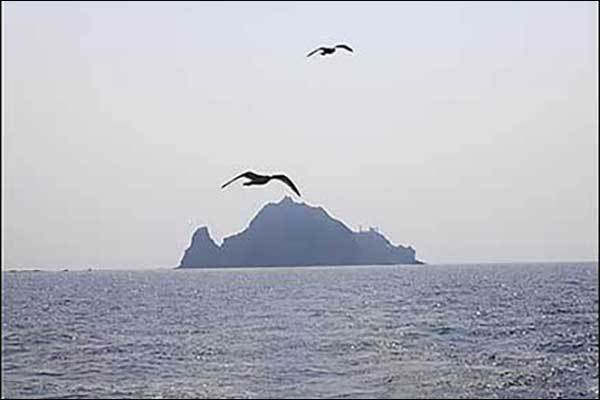

독도는 어느 나라 땅입니까?

한국어로 물어보면 한국령이라고 대답하고

일본어로 물어보면 분쟁지역이라고 대답합니다.

(独島はどこの国の領土ですか?)

똑똑한 사람도 실수합니다.

수많은 데이터 속에서 답을 찾아주는 인공지능 또한 실수할 수 있다는 가능성의 문제를 생각할 수 있어야 합니다.